Robots.txt là một tệp tin văn bản nằm trong thư mục gốc của trang web và cung cấp hướng dẫn cho các công cụ tìm kiếm thu thập thông tin về các trang mà họ có thể thu thập thông tin để lập chỉ mục.

Một trong những điều đầu tiên bạn cần phải kiểm tra và tối ưu hóa khi làm việc về SEO kỹ thuật của bạn là file robots.txt. Sự cố hoặc cấu hình sai trong robots.txt của bạn có thể gây ra các vấn đề SEO quan trọng có thể tác động tiêu cực đến thứ hạng và lượng truy cập của bạn.

Trong bài đăng này, bạn sẽ biết được file robots.txt là gì, tại sao bạn cần nó, làm thế nào để SEO tối ưu hóa nó và làm thế nào để kiểm tra rằng các công cụ tìm kiếm có thể truy cập nó mà không có bất kỳ vấn đề gì.

Nếu bạn đang sử dụng WordPress ở cuối bài viết này, bạn sẽ có thông tin cụ thể về tệp robots.txt mặc định của WordPress. Cũng có nhiều bạn mắc sai lầm trong những lần cài đặt website WordPress lần đầu, tôi sẽ phổ biến kèm nội dung dưới đây.

Robots.txt là gì?

Robots.txt là một tệp tin văn bản nằm trong thư mục gốc của trang web và cung cấp hướng dẫn cho các công cụ tìm kiếm thu thập thông tin về các trang mà họ có thể thu thập thông tin để lập chỉ mục.

Nếu bạn đã đọc bài trước của tôi về cách các công cụ tìm kiếm hoạt động, thì bạn sẽ biết rằng trong giai đoạn thu thập thông tin và lập chỉ mục, các công cụ tìm kiếm cố gắng tìm các trang có sẵn công khai trên web, mà chúng có thể đưa vào trong chỉ mục của chúng.

Khi truy cập trang web, điều đầu tiên công cụ tìm kiếm làm là tìm kiếm và kiểm tra nội dung của tệp robots.txt. Tùy thuộc vào các quy tắc được chỉ định trong tệp, chúng tạo ra một danh sách các URLS có thể thu thập dữ liệu và sau đó lập chỉ mục cụ thể cho trang web.

Nội dung của tệp robots.txt được công khai trên Internet. Trừ khi được bảo vệ bằng cách khác (tôi cũng chưa biết bảo vệ bằng cách nào), bất kỳ ai cũng có thể xem nội dung tệp robots.txt của bạn vì vậy đây không phải là nơi để thêm nội dung mà bạn không muốn người khác xem.

Điều gì sẽ xảy ra nếu bạn không có tệp robots.txt? Nếu tệp robots.txt bị thiếu, trình thu thập thông tin của công cụ tìm kiếm giả sử rằng tất cả các trang có sẵn trên trang web của bạn đều ở chế độ công khai và nó có thể được thu thập dữ liệu -> thêm vào chỉ mục của nó.

Điều gì sẽ xảy ra nếu robots.txt không được định dạng tốt? Nó phụ thuộc vào vấn đề. Nếu các công cụ tìm kiếm không thể hiểu nội dung của tệp tin vì nó bị định cấu hình sai, họ vẫn truy cập vào trang web và bỏ qua bất cứ điều gì trong robots.txt.

Điều gì sẽ xảy ra nếu tôi vô tình chặn các công cụ tìm kiếm truy cập trang web của tôi? Đó là một vấn đề lớn. Đối với người mới bắt đầu, công cụ tìm kiếm sẽ không thu thập thông tin và lập chỉ mục trang từ trang web của bạn và dần dần họ sẽ xóa bất kỳ trang nào đã có trong chỉ mục của họ.

Bạn có cần tệp Robots.txt không?

Có, chắc chắn bạn cần có robots.txt ngay cả khi bạn không muốn loại trừ bất kỳ trang hoặc thư mục nào của trang web khỏi xuất hiện trong kết quả của công cụ tìm kiếm.

Tại sao lại sử dụng robots.txt?

Các trường hợp sử dụng robots.txt phổ biến nhất là như sau:

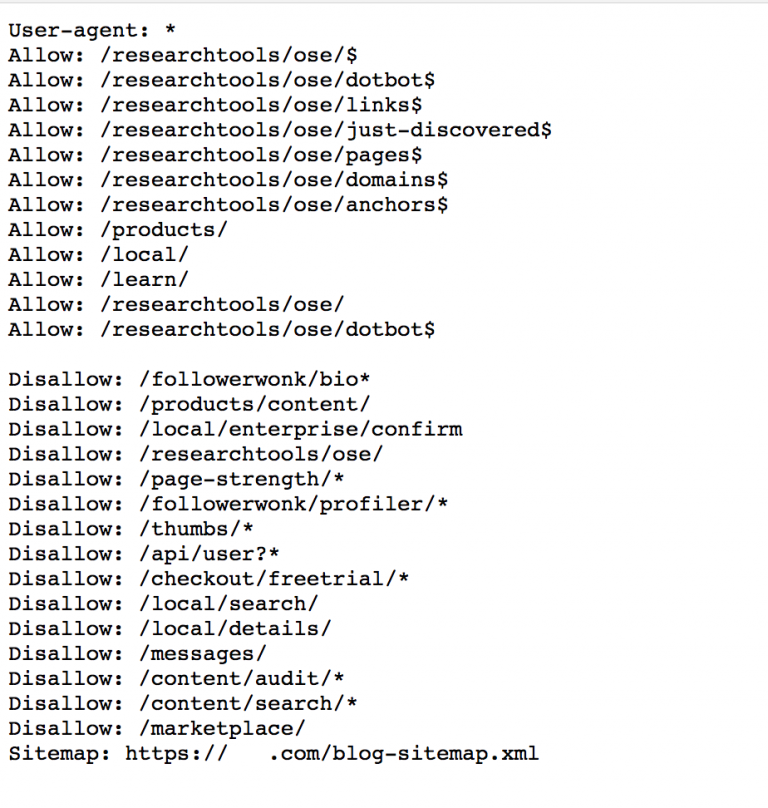

# 1 – Để chặn các công cụ tìm kiếm truy cập các trang hoặc thư mục cụ thể của trang web của bạn. Ví dụ: xem robots.txt bên dưới và chú ý đến các quy tắc không cho phép.

Ví dụ về Robots.txt

Các câu lệnh này hướng dẫn trình thu thập thông tin của công cụ tìm kiếm không lập chỉ mục các thư mục cụ thể. Lưu ý rằng bạn có thể sử dụng ký tự * làm ký tự thẻ tự do. Ví dụ trên bạn nhìn dòng Disallow: /followerwonk/bio* thì tất cả những tệp, trang tại thư mục /followerwonk/bio đều bị chặn, ví dụ: Disallow: /followerwonk/biovietnet.html hoặc Disallow: /followerwonk/biovietnet.

# 2 – Khi bạn có một trang web lớn, thu thập thông tin và lập chỉ mục có thể là một quy trình rất tốn tài nguyên. Trình thu thập thông tin từ các công cụ tìm kiếm khác nhau sẽ cố gắng thu thập dữ liệu và lập chỉ mục toàn bộ trang web của bạn và điều này có thể gây ra các vấn đề về hiệu năng nghiêm trọng.

Trong trường hợp này, bạn có thể sử dụng robots.txt để hạn chế quyền truy cập vào một số phần nhất định của trang web mà không quan trọng đối với SEO hoặc thứ hạng. Bằng cách này, bạn không chỉ làm giảm tải trên máy chủ của bạn mà nó làm cho toàn bộ quá trình lập chỉ mục nhanh hơn.

# 3 – Khi bạn quyết định sử dụng URL rút gọn cho liên kết liên kết của mình. Không giống như che giấu nội dung hoặc che giấu URLS để lừa người dùng hoặc công cụ tìm kiếm thì đó là quy trình hợp lệ để làm cho các liên kết liên kết của bạn dễ quản lý hơn.

Hai điều quan trọng cần biết về robots.txt

Điều đầu tiên là bất kỳ quy tắc nào bạn thêm vào robots.txt thì đó là chỉ thị. Điều này có nghĩa là công cụ tìm kiếm phải tuân theo và tuân theo các quy tắc bạn đã đưa vào.

Trong hầu hết các trường hợp công cụ tìm kiếm đều mò vào công việc thu thâp -> lập chỉ mục, nhưng nếu bạn có nội dung mà bạn không muốn nằm trong chỉ mục của họ thì cách tốt nhất là để mật khẩu bảo vệ thư mục hoặc trang cụ thể.

Điều thứ hai là ngay cả khi bạn chặn trang hoặc thư mục trong robots.txt, nó vẫn có thể xuất hiện trong kết quả tìm kiếm nếu nó có liên kết từ các trang khác đã được lập chỉ mục. Nói cách khác, thêm trang bạn muốn chặn vào robots.txt không đảm bảo rằng nó sẽ bị xóa hoặc không xuất hiện trên web. Trước đây tôi có thường xuyên nhìn thấy các kết quả với mô tả “Không có mô tả cho kết quả tìm kiếm hoặc bị chặn”.

Ngoài mật khẩu bảo vệ trang hoặc thư mục, một cách khác là sử dụng chỉ thị của trang bằng cách thêm vào trong <head> của mỗi trang một thẻ meta như dưới đây thì sẽ chặn được việc lập chỉ mục:

<meta name=”robots” content=”noindex”>

Robots.txt hoạt động như thế nào?

Tệp robot có một cấu trúc rất đơn giản. Có một số kết hợp từ khóa / giá trị được xác định trước mà bạn có thể sử dụng.

Phổ biến nhất là: User-agent, Disallow, Allow, Crawl-delay, Sitemap.

User-agent: Chỉ định trình thu thập dữ liệu nào được đưa vào các chỉ thị. Bạn có thể sử dụng một * để cho tất cả các trình thu thập thông tin hoặc nếu không thích thì bạn có thể chỉ định tên của trình thu thập thông tin, xem ví dụ dưới đây.

Bạn có thể xem tất cả các tên và giá trị có sẵn cho chỉ thị user-agent, tại đây.

User-agent: * – bao gồm tất cả trình thu thập thông tin.

User-agent: Googlebot – chỉ dành cho Google bot.

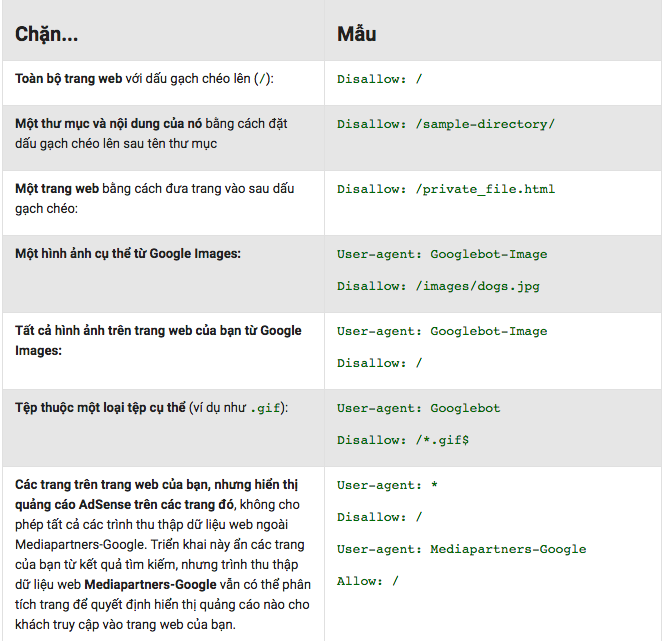

Disallow: Chỉ thị hướng dẫn các bot (được chỉ định ở trên) không thu thập dữ liệu URL hoặc một phần của trang web.

Giá trị của disallow có thể là một tệp, URL hoặc thư mục cụ thể. Xem ví dụ dưới đây được thực hiện từ bộ phận hỗ trợ kỹ thuật của Google.

Allow: Chỉ thị cho biết rõ các trang hoặc thư mục con nào có thể được truy cập. Điều này chỉ áp dụng cho Googlebot.

Bạn có thể sử dụng Allow để cho phép truy cập vào một thư mục con cụ thể trên trang web của bạn, mặc dù thư mục gốc là không được phép.

Ở ví dụ dưới đây tôi chặn thư mục photo nhưng tôi tại cho phép lập chỉ mục trong photos/vietnetgroup

User-agent: *

Disallow: /photos

Allow: /photos/vietnetgroup/

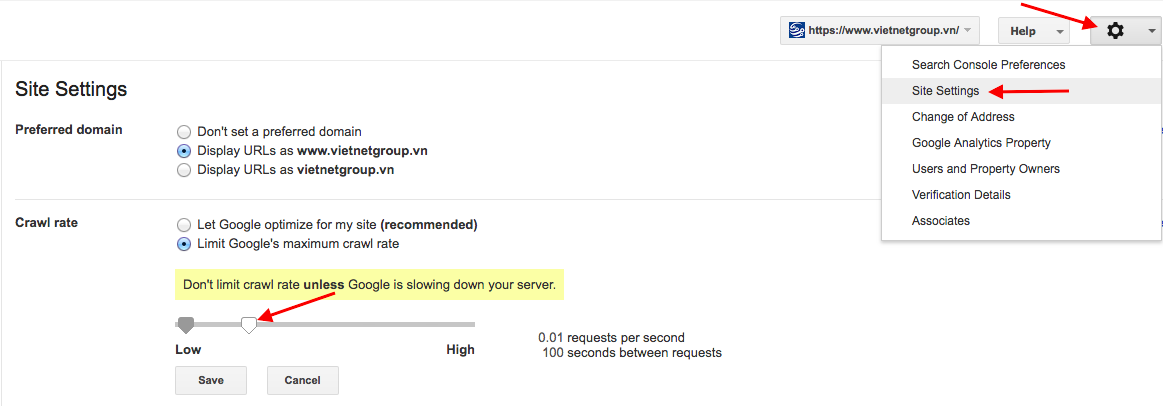

Crawl-delay: Bạn có thể để cụ thể một giá trị để buộc trình thu thập dữ liệu thu thập thông tin của công cụ tìm kiếm đợi một khoảng thời gian cụ thể trước khi thu thập thông tin trang tiếp theo từ trang web của bạn. Giá trị bạn nhập đơn vị là mili giây.

Cần lưu ý rằng Googlebot không tính đến độ Crawl-delay này.

Bạn có thể sử dụng Google Search Console để kiểm soát tốc độ thu thập thông tin cho Google (tùy chọn này ở trong Cài đặt trang web) tôi chụp ảnh màn hình dưới đây.

Bạn có thể sử dụng Crawl-delay trong trường hợp bạn có trang web với hàng ngàn trang và bạn không muốn quá tải máy chủ của mình với các yêu cầu liên tục.

Trong phần lớn các trường hợp, bạn không nên sử dụng chỉ thị thu thập dữ liệu trễ này làm gì.

Sitemap: Chỉ thị sitemap được hỗ trợ bởi các công cụ tìm kiếm chính bao gồm Google và nó được sử dụng để chỉ định vị trí của Sơ đồ trang web XML của bạn. (Nếu muốn xem bài sơ đồ trang XML thì nhấp vào link bên cạnh đó nhé)

Ngay cả khi bạn không chỉ định vị trí của sơ đồ trang XML trong robot.txt, các công cụ tìm kiếm vẫn có thể tìm thấy nó.

Một điều lưu ý quan trọng cho bạn đó là robots có phân biệt chữ hoa và chữ thường. Ví dụ: Disallow: /File.html thì sẽ không khóa được file.html

Cách tạo file robots.txt

Tạo tệp robots.txt rất dễ dàng. Tất cả bạn cần là một trình soạn thảo văn bản (tôi thường xùng notepad) và truy cập các tệp của trang web của bạn (qua FTP hoặc bảng điều khiển quản lý hosting).

Trước khi tham gia quá trình tạo tệp tin robot, điều đầu tiên cần làm là kiểm tra xem nó đã có chưa.

Cách dễ nhất để làm việc này là mở một cửa sổ trình duyệt mới và truy cập đến https://www.tênmiền.com/robots.txt

Nếu bạn thấy một thứ tương tự như dưới đây, có nghĩa là bạn đã có tệp robots.txt và bạn có thể chỉnh sửa tệp hiện tại thay vì tạo tệp mới.

User-agent: *

Allow: /

Cách chỉnh sửa robots.txt

Sử dụng ứng dụng khách FTP và kết nối với thư mục gốc của trang web của bạn.

Robots.txt luôn nằm trong thư mục gốc (www hoặc public_html, tùy thuộc vào máy chủ của bạn).

Tải tập tin về máy tính của bạn và mở nó bằng một trình soạn thảo văn bản.

Thực hiện các thay đổi cần thiết và tải tệp lên máy chủ của bạn.

Ví dụ về tệp tin robots.txt

User-agent: *

Allow: /

Sitemap: https://example.com/sitemap.xml

Điều này cho phép tất cả các chương trình truy cập trang web của bạn mà không chặn bất kỳ thư mục, url nào. Nó cũng xác định vị trí sơ đồ trang web để làm cho các công cụ tìm kiếm dễ tìm nó hơn.

Cách kiểm tra và xác nhận hợp lệ cho robots.txt?

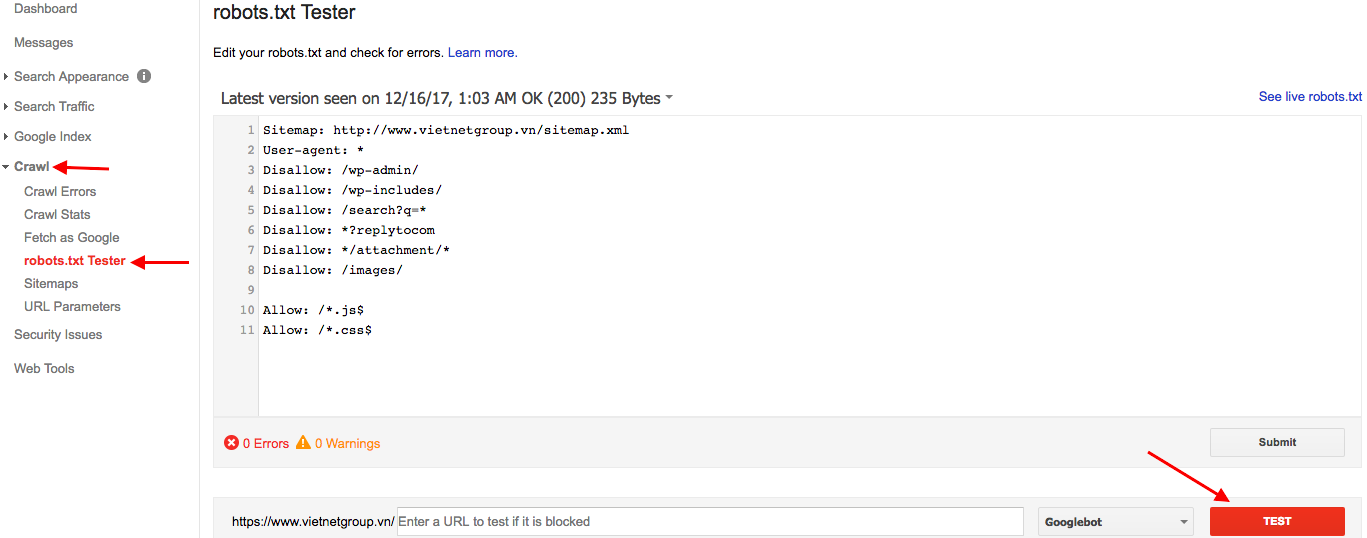

Mặc dù bạn có thể xem nội dung robots.txt của mình bằng cách điều hướng tới robots.txt URL nhưng cách tốt nhất để kiểm tra và xác nhận nó là thông qua tùy chọn robots.txt Tester của Google Search Console.

Đăng nhập vào Tài khoản Google Search Console của bạn.

Nhấp vào robots.txt Tester, được tìm thấy trong Tùy chọn Crawl.

Nhấp vào nút TEST.

Nếu mọi thứ đều ổn, nút Test sẽ chuyển sang màu xanh và nhãn sẽ thay đổi ALLOWED. Nếu xảy ra sự cố, đường kẻ gây ra lỗi sẽ được đánh dấu.

Một vài điều nữa cần biết về robots.txt Tester:

Bạn có thể sử dụng URL Tester (dưới cùng của công cụ) để nhập URL từ trang web của bạn và kiểm tra xem nó có bị chặn hay không.

Bạn có thể thực hiện bất kỳ thay đổi nào đối với trình soạn thảo và kiểm tra các quy tắc mới nhưng để các ứng dụng này được áp dụng cho robots.txt trực tiếp của bạn, bạn cần EDIT tệp của mình bằng trình chỉnh sửa văn bản và tải tệp lên thư mục gốc của trang web của bạn (như đã giải thích ở trên ).

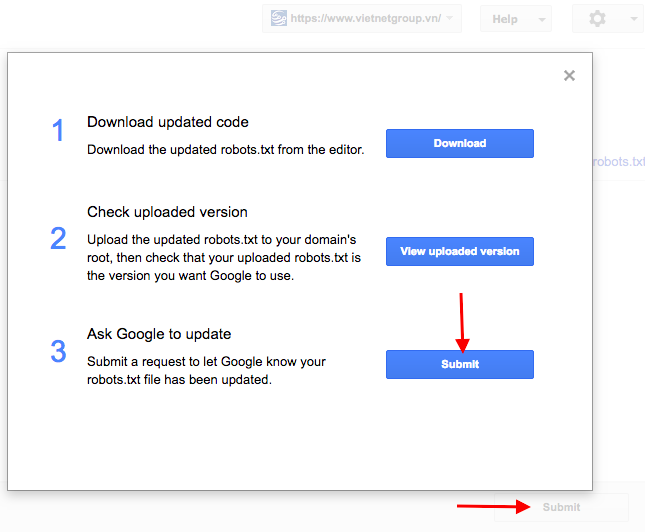

Để thông báo cho Google rằng bạn đã thực hiện thay đổi robots.txt, hãy nhấp vào nút SUBMIT (từ ảnh màn hình ở trên) và nhấp vào nút SUBMIT một lần nữa từ cửa sổ bật lên (tùy chọn 3 như được hiển thị bên dưới).

Robots.txt với WordPress?

Tất cả những gì bạn đọc cho đến nay về robots.txt cũng áp dụng cho các trang web WordPress.

Những điều bạn cần biết về robots.txt và WordPress là như sau:

WordPress mặc định sử dụng tệp robots.txt ảo. Điều này có nghĩa là bạn không thể trực tiếp chỉnh sửa tập tin hoặc tìm nó trong thư mục gốc của thư mục của bạn.

Cách duy nhất để xem nội dung của tệp là gõ https://www.tênmiền.com/robots.txt trong trình duyệt của bạn.

Các giá trị mặc định của WordPress robots.txt là:

User-agent: *

Disallow: / wp-admin /

Allow: /wp-admin/admin-ajax.php

Sử dụng Plugins Yoast SEO thì mọi thứ dễ dàng hơi với việc chỉnh sửa file robots.txt bằng thao tác bạn vào SEO -> Tools -> File editor và chỉnh nội dung robots.txt sau đó lưu lại.

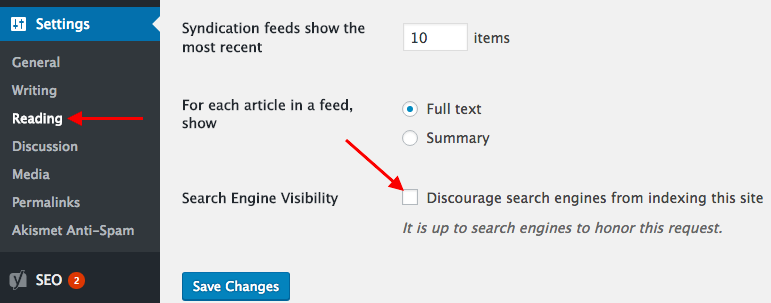

Thêm một điều nữa lưu ý mà khi các bạn cài đặt WordPress thường gặp đó là việc các bạn lựa chọn chặn tất cả các công cụ tìm kiếm đến trang web. Điều này tôi cũng thường làm khi mới bắt đầu xây dựng 1 Website WordPress, nhưng sau khi hoàn thiện thì tôi sẽ mở ra cho các công cụ tìm kiếm vào.

Nếu bạn tích vào ô đó thì mọi công cụ tìm kiếm sẽ không vào Website của bạn

Robots.txt thực tế tốt nhất cho SEO

Kiểm tra robots.txt của bạn và đảm bảo rằng bạn không chặn bất kỳ phần nào của trang web mà bạn muốn xuất hiện trong các công cụ tìm kiếm.

Không chặn thư mục CSS hoặc JS. Google trong quá trình thu thập thông tin và lập chỉ mục có thể xem một trang web như một người dùng thực và nếu các trang của bạn cần JS và CSS hoạt động đúng cách, chúng sẽ không bị chặn.

Nếu bạn đang sử dụng WordPress, bạn không cần phải chặn truy cập vào các thư mục wp-admin và wp-include. WordPress thực hiện công việc tuyệt vời bằng thẻ meta robots. Tuy nhiên, làm thì cũng không sao.

Không nên cố gắng chỉ định các quy tắc khác nhau cho mỗi bot của công cụ tìm kiếm, nó có thể gây nhầm lẫn và khó để cập nhật. Sử dụng user-agent tốt nhất là: * và cung cấp một bộ quy tắc cho tất cả các chương trình.

KẾT LUẬN

Bạn không phải mất quá nhiều thời gian để cấu hình hoặc thử nghiệm robots.txt của mình. Điều quan trọng là phải có và thử nghiệm thông qua Công cụ Quản trị Trang web của Google để chắc chắn rằng bạn không chặn trình thu thập thông tin của công cụ tìm kiếm truy cập vào trang web của bạn.

Đó là một công việc bạn cần làm một lần khi bạn lần đầu tiên tạo trang web của bạn hoặc như một phần kỹ thuật đầu tiên khi bạn kiểm tra SEO một trang web.

Biên soạn: Phong Vũ

Xin chào adm, adm xem giúp mình blog này với matnguon.blogspot.com

Mình tự học nên cũng k hiểu nhiều về thuật ngữ, bạn có thể giúp mình cài Robots.txt tùy chỉnh và Thẻ tiêu đề robot tùy chỉnh tối ưu được không. mình muốn gg index trang chủ, bài viết, label và các trang. còn lại chặn không cho index. b có thể cho m xin code chuẩn được không

Chào bạn ! Bạn đang sử dụng Blogspot. Nếu để sửa robots.txt của Blogspot và tùy chỉnh nội dung theo ý bạn muốn thì bạn có thể tham khảo ở bài viết hướng dẫn này của mình:

http://www.itviet360.com/2014/04/cach-tuy-chinh-robotstxt-trong-blogspot.html

Quá lâu rồi mình không viết về Blogspot nhưng hướng dẫn đó vẫn còn dùng được và chưa có thay đổi.

Cảm ơn bạn !